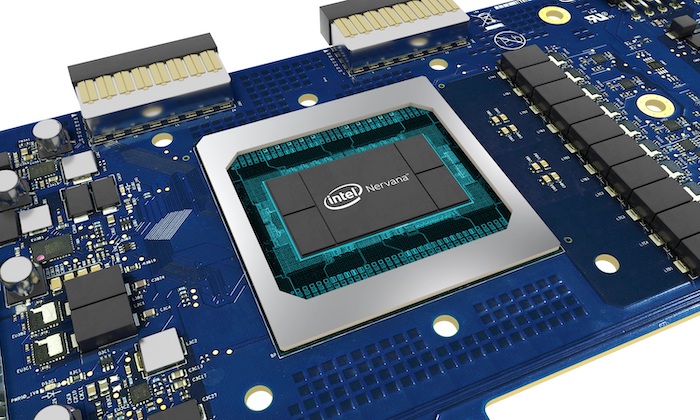

인텔이 인공지능을 위해 개발된 전용 프로세서 인텔 너바나(Intel Nervana)의 정보를 공개했다. 고성능 인공지능(AI) 가속기인 너바나 프로세서 제품군에는 인공지능 훈련을 위한 NNP-T와 추론용인 NNP-I가 포함된다.

대량의 데이터를 활용 가능한 정보로 바꾸고 여기에서 지식을 얻어내는 것이 인공지능 기술을 활용하는 이유라고 할 수 있다. 인텔은 새롭고 복잡한 활용 사례 및 인공지능 기술을 발전시키고 지원할 수 있는 하드웨어 아키텍처와 패키징, 메모리, 스토리지 및 인터커넥트 기술이 중요하다고 보고 있다. 인텔의 너바나 NNP(Neural Network Processor)와 같은 전용 가속기는 처음부터 인공지능에 중점을 두고 개발된 것으로, 올바른 인텔리전스를 적절한 시기에 제공하기 위한 것이다.

인텔 너바나 NNP-T는 정해진 전력을 사용해 가능한 빠르게 신경망을 학습시키는 것에 중심을 두면서 딥러닝 트레이닝의 경계를 확장하기 위한 '딥러닝 트레이닝 프로세서'이다. 유연성을 염두에 두고 구축되어 컴퓨팅, 통신 및 메모리 간의 균형을 유지한다.

인텔 제온 스케일러블(Intel Xeon Scalable) 프로세서와 다르게, NNP-T는 레거시 기술의 지원에 신경쓰지 않고 대형 학습 모델을 해결하는데 필요한 기능과 요구 사항을 담을 수 있도록 설계된 것이 특징이다. 미래의 딥러닝 요구를 충족하기 위해 인텔 너바나 NNP-T는 유연성과 프로그래머블 기능으로 구축되어 기존 워크로드뿌 아니라 앞으로 나타날 수 있는 새로운 워크로드도 가속화할 수 있도록 설계되었다.

인텔 너바나 NNP-I는 추론을 위해 특수 제작되어 대규모로 딥러닝 구축을 가속화하도록 설계되었다. 데이터 센터 워크로드에서 높은 와트 당 성능을 제공할 수 있도록 아이스 레이크(Ice Lake) 코어를 이용한 인텔의 10나노 공정 기술에 기반하고 있다.

또한 인텔 너바나 NNP-I는 성능이나 전력 효율성 저하 없이 높은 수준의 프로그래머블 기능을 제공한다. 쉬운 프로그래밍, 짧은 지연 시간, 빠른 코드 포팅 및 주요한 딥러닝 프레임워크를 지원하는 전용 추론 가속기를 사용한다.

인텔의 부사장 겸 AI 제품 그룹의 총괄 매니저인 나빈 라오(Naveen Rao)는 “미래에 '모든 곳에 인공지능(AI Everywhere)'을 구현하기 위해서는 생성되는 대량의 데이터를 기업에서 효율적으로 처리하고 활용할 수 있도록 지원해야 한다”며, “데이터 센터와 클라우드는 복잡한 인공지능 애플리케이션을 위해 성능이 뛰어나고 확장 가능한 범용 컴퓨팅 및 전문화된 가속이 필요하다. 모든 곳에 인공지능이라는 미래의 비전에는 하드웨어에서 소프트웨어, 애플리케이션에 이르는 종합적인 접근 방식이 필요하다”고 전했다.